FabImage® Library Suite

Bildverarbeitungs-Bibliothek für C++ und .NET

Hauptvorteile

- Höchste Leistung

- Modernes Design

- Einfache Struktur

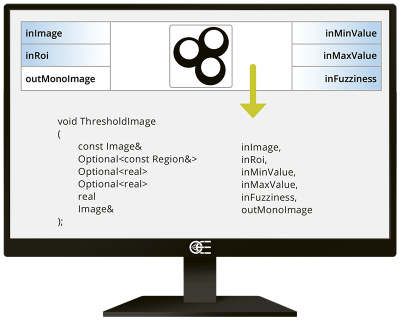

FabImage Library Suite ist eine Bildverarbeitungsbibliothek für C++ und .NET-Programmierer. Sie bietet einen umfassenden Satz an Funktionen für die Erstellung industrieller Bildanalyseapplikationen - von standardbasierten Bildaufnahmeschnittstellen über Low-Level-Bildverarbeitungsroutinen bis hin zu einsatzbereiten Werkzeugen wie Template-Matching, Messungen und Barcode-Lesegeräten.

Zu den zentralen Stärken des Produkts gehören sein außergewöhnliches Leistungsprofil, das moderne Design und die einfache Struktur, die eine leichte Integration in Ihren Code ermöglicht. Die in FabImage Library verfügbaren Funktionen entsprechen weitgehend den Filtern von FabImage Studio. Daher ist es möglich, Ihre Algorithmen schnell in einer grafischen Umgebung aufzubauen und sie dann in C++ oder .NET zu übersetzen oder sogar den C++-Code automatisch zu generieren.

Mit der Fabimage Library Suite haben Sie sofortigen Zugriff auf den qualitativ hochwertigen, gut optimierten und praxiserprobten Code, den Sie für Ihre Bildverarbeitungsprojekte benötigen!

Three types of Licenses are available:

Developer Licenses: Licenses required to develop a vision program.

Runtime Licenses: Licenses required to run a vision program. To purchase a Runtime License, you must have purchased a Developer License.

Add-on Licenses: Additional Licenses that allow you to expand the functionality of the other two types of Licenses.

Developer licenses

The Developer License is assigned to a single developer user and can be activated only via USB dongle. Free Technical Support services are included for the first 12 months after activation, such as:

- Most up-to-date version of the software with associated new features and documentation*

- Answers, via email, to technical questions related to the use of the software

After 12 months from the activation of the Developer License, it is necessary to purchase a Service License (FIL-EXT) in order to:

purchase additional Single Thread Runtime Licenses (FIL-RUN).

take advantage of the Technical Support services.

| * To obtain the most up-to-date version of the software, you must send Opto Engineering the WIBU file associated with the USB dongle of the License you wish to have the upgrade on. Learn more about how and where to download the WIBU file at https://docs.fab-image.com/stu... | |||

| P/N | Description | Category | Features |

| FIL-SUI | FabImage® Library Suite (C++ and .NET) | Developer Basic License | Development environment (IDE) for direct programming in C++ or .NET. This type of License is suitable for those who prefer to program in C++ or C# and do not want to employ graphical programming. Allows multi-camera acquisition and development of processes (macrofilters) sequentially (single thread) |

| USB-DONGLE-FI | USB Dongle | Hardware | Required to activate the License via hardware USB dongle. |

ADD-ON License

ADD-ON Licenses** are additional Licenses that allow you to expand the functionality of the Basic License. To purchase ADD-ON Licenses, you must have purchased a Developer FabImage® Library Suite License (FIL-SUI) .

| ** To order an ADD-ON License, you must also send the WIBU file associated with the USB dongle of the developer for which you wish to activate the add-on. Read more about how and where to download the WIBU file at this link. | |||

| *** It is not possible to build multiple macrofilters with Deep Learning that work in parallel. | |||

P/N |

Description |

Category |

Features |

FIL-PAR-ADD |

Parallel Processing ADD-ON for those who have purchased FabImage® Library Suite (FIL-SUI) |

Developer ADD-ON License |

Allows the user to:

|

FI-DL-ADD |

FabImage® Deep Learning ADD-ON for those who have already purchased FabImage® Library Suite (FIL-SUI) |

Developer ADD-ON License |

Allows the user to use Deep Learning Tools ***. Visit the Deep Learning section for more information. |

Runtime Licenses

Runtime License SINGLE THREAD

The Runtime License is assigned to a single vision system and allows multi-camera acquisition and execution of processes (macrofilters) sequentially (single thread). It can be activated via two options:

USB Dongle (USB-DONGLE-RUN)

Computer ID*

To purchase a Single Thread Runtime License, you must have purchased the FabImage® Library Suite Developer License (FIL-SUI). After 12 months from the activation of the Developer License, you are required to purchase the Service License (FIL-EXT) to continue purchasing Single Thread Runtime Licenses.

| * In case the License is lost through damage to the Computer, to which it is assigned by Computer ID, it cannot be recovered and a new one must be purchased. Opto Engineering recommends the option to purchase the license via USB dongle. | |||

P/N |

Description |

Category |

Features |

FIL-RUN |

FabImage® Library Runtime |

Runtime License |

Allows you to run an unlimited number of processes (macrofilters) sequentially |

USB-DONGLE-RUN |

USB Dongle (Optional) |

Hardware |

The License is activated via USB dongle |

Runtime License MULTITHREADING

In order to run the Parallel Processing (FIL-PAR-ADD) features, you must purchase one of the following Runtime Licenses (these Runtime Libraries replace the FabImage® Library Single Thread Runtime (FIL-RUN)). To purchase a Multithreading Runtime License, you must have purchased a FabImage® Library Suite Developer License (FIL-SUI) and a Developer Parallel Processing ADD-ON License (FIL-PAR-ADD).

After 12 months from the activation of the Developer Parallel Processing ADD-ON License (FIL-PAR-ADD), you are required to purchase a Service License (FIL-EXT) if you wish to continue purchasing Multithreading Runtime Licenses.

P/N |

Description |

Category |

Features |

FIL-RUN-CL-XX* |

|||

FIL-RUN-CL-4 |

FabImage® Library Runtime for a 4-core machine vision computer |

ADD-ON Runtime License for Parallel Processing |

Allows running an unlimited number of processes in parallel. Requires a PC with 4 cores. |

FIL-RUN-CL-6 |

FabImage® Library Runtime for a 6-core machine vision computer |

ADD-ON Runtime License for Parallel Processing |

Allows running an unlimited number of processes in parallel. Requires a PC with 6 cores. |

FIL-RUN-CL-8 |

FabImage® Library Runtime for an 8-core machine vision computer |

ADD-ON Runtime License for Parallel Processing |

Allows running an unlimited number of processes in parallel. Requires a PC with 8 cores. |

FIL-RUN-CL-16 |

FabImage® Library Runtime for a 16-core machine vision computer |

ADD-ON Runtime License for Parallel Processing |

Allows running an unlimited number of processes in parallel. Requires a PC with 16 cores. |

FIL-RUN-TL-XX |

|||

FIL-RUN-TL-2 |

FabImage® Library Runtime limited to 2 Threads |

ADD-ON Runtime License for Parallel Processing |

Enables the use of PCs with any number of Cores. The number of parallel processes is limited to 2 threads. |

FIL-RUN-TL-4 |

FabImage® Library Runtime limited to 4 Threads |

ADD-ON Runtime License for Parallel Processing |

Enables the use of PCs with any number of Cores. The number of parallel processes is limited to 4 threads. |

FIL-RUN-TL-6 |

FabImage® Library Runtime limited to 6 Threads |

ADD-ON Runtime License for Parallel Processing |

Enables the use of PCs with any number of Cores. The number of parallel processes is limited to 6 threads. |

FIL-RUN-TL-8 |

FabImage® Library Runtime limited to 8 Threads |

ADD-ON Runtime License for Parallel Processing |

Enables the use of PCs with any number of Cores. The number of parallel processes is limited to 8 threads. |

FIL-RUN-TL-16 |

FabImage® Library Runtime limited to 16 Threads |

ADD-ON Runtime License for Parallel Processing |

Enables the use of PCs with any number of Cores. The number of parallel processes is limited to 16 threads. |

* To run an unlimited number of processes in parallel, it is recommended to purchase the Runtime License, which corresponds to the number of cores on the machine vision computer.

ADD-ON Runtime License DEEP LEARNING

In order to run the Deep Learning ADD-ON features, the following Runtime License must be purchased in addition to the FabImage® Library Runtime (FIL-RUN).

To purchase the Deep Learning ADD-ON Runtime, you must have purchased a FabImage® Library Suite Developer License (FIL-SUI) and a Developer Deep Learning ADD-ON License (FI-DL-ADD). After 12 months from the activation of the Developer ADD-ON License (FI-DL-ADD), you will be required to purchase the Service License (DL-EXT), if you wish to purchase a Deep Learning ADD-ON Runtime License.

P/N | Description | Category | Features |

FIL-RUN-DL | FabImage® Library Deep Learning ADD-ON Runtime | Deep Learning ADD-ON Runtime License. | Enables the user to execute single-threaded Deep learning* |

* Multiple GPU cards cannot be used for inference

After 12 months from the activation of the FabImage® Library Suite Developer License (FIL-SUI) or Developer ADD-ON Licenses (FIL-PAR-ADD and FI-DL-ADD), it is required to purchase one of the following Service Licenses for:

Purchasing Additional Single-Threaded Runtime Licenses (FIL-RUN) or Multithreading Runtime Licenses (FIL-RUN-CL-xx or FIL-RUN-TL-xx)

Purchasing Additional Deep Learning ADD-ON Runtime Licenses (FIL-RUN-DL)

Maintaining active technical support

P/N | Description | Category | Features |

FIL-EXT | FabImage® Library Suite EXTENSION

| Service License | License required for:

3) Maintaining active technical support |

DL-EXT* | FabImage® Deep Learning ADD-ON Extension | Service License | License required for: 1) Purchasing Additional Deep Learning ADD-ON Runtime Licenses 2) Maintaining active technical support |

Leistung

FabImage Library Suite besticht durch seine sorgfältig gestalteten Algorithmen und seine umfangreichen Hardware-Optimierungen - eine Kombination, die die Bibliothek zu einer der schnellsten der Welt macht. Unsere Implementierungen arbeiten mit SSE-Befehlen und parallelen Berechnungen mithilfe von Multicore-Prozessoren.

Modernes Design

Alle Datentypen verfügen über eine automatische Speicherverwaltung, Fehler werden explizit mit Ausnahmen behandelt und optionale Typen werden für typensichere Sonderwerte verwendet. Alle Funktionen sind Thread-sicher und nutzen, wenn möglich, die Datenparallelität intern.

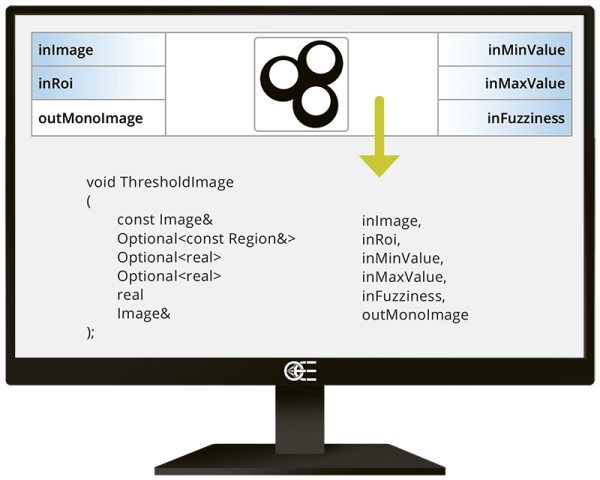

Einfach & Einheitlich

Die Bibliothek ist eine einfache Sammlung von Typen und Funktionen, die als eine einzige DLL-Datei mit entsprechenden Headern zur Verfügung gestellt wird. Für eine maximale Lesbarkeit der Funktionen ist eine einheitliche Namenskonvention zu beachten (z.B. die Form VERB + SUBSTANTIV, wie bei: SmoothImage, RotateVector). Alle Ergebnisse werden über Referenzausgabeparameter zurückgespielt, wodurch immer viele Ausgaben möglich sind.

Vorwort

Deep Learning Add-on ist eine bahnbrechende Technologie für die Bildverarbeitung. Es handelt sich um einen Satz von fünf vorgefertigten Werkzeugen, die mit 20 bis 50 Beispielbildern trainiert werden und dann Objekte, Fehler oder Merkmale automatisch erkennen. Intern werden große neuronale Netze verwendet, die von unserem Forschungsteam für den Einsatz in industriellen Bildverarbeitungssystemen entwickelt und optimiert wurden.

Zusammen mit Fabimage Studio Professional erhalten Sie eine Komplettlösung für die Schulung und Bereitstellung moderner Bildverarbeitungsanwendungen.

Hauptvorteile

TRAININGSDATEN

Typische Anwendungen erfordern zwischen 20 und 50 Bilder für das Training. Je mehr desto besser, aber unsere Software lernt intern wichtige Merkmale aus einem begrenzten Trainingssatz und generiert dann Tausende neuer künstlicher Proben für ein effektives Training.

AUSRÜSTUNG

Für ein effektives Training ist eine moderne GPU erforderlich. In der Produktion können Sie entweder GPU oder CPU verwenden. Die GPU ist normalerweise 3-10 mal schneller (mit Ausnahme der Objektklassifizierung, die auf der CPU gleich schnell ist).

GESCHWINDIGKEIT

Die typische Trainingszeit auf einer GPU beträgt 5-15 Minuten. Die Inferenzzeit variiert je nach Werkzeug und Hardware zwischen 5 und 100 ms pro Bild. Die höchste Leistung garantiert WEAVER, eine industrielle Inferenzmaschine.

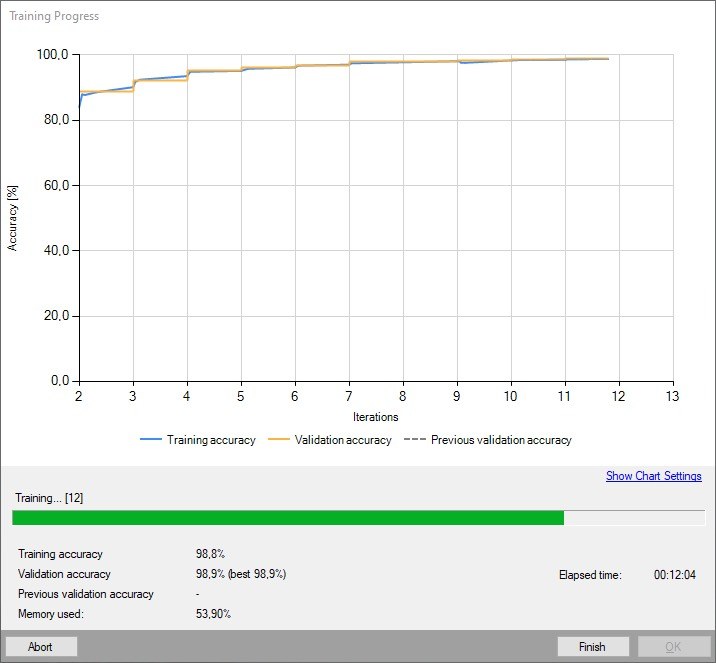

Trainingsprozess

1. Bilder erheben und normalisieren

- Beschaffen Sie 20 - 50 Bilder, die richtige und unrichtige Beispiele schildern und alle möglichen Abarten der Objekte darstellen; speichern Sie sie auf der Platte.

- Sorgen Sie dafür, dass die Skala, die Orientierung und die Beleuchtung möglichst einheitlich sind.

Training

- Öffnen Sie das FabImage Studio Professional und aktivieren Sie eines der Deep Learning Add-on-Tools

- Öffnen Sie einen mit dem Tool verknüpften Editor und laden Sie Ihre Trainingsbilder in das Programm rein

- Sie können Ihre Bilder beschriften oder Markierungen mit Zeichenwerkzeugen hinzufügen

- Klicken Sie auf "Train" (Trainieren)

Trainings- und Validierungsdaten

Beim tiefen Lernen und in sonstigen Bereichen des maschinellen Lernens ist die Anwendung der richtigen Methodik von besonderer Bedeutung. Am wichtigsten ist es, die Trainingsdaten von den Validierungsdaten abzutrennen. Die Trainingsdaten sind eine Aufstellung von Bildern, die genutzt wird, um das Modell zu trainieren. Diese Daten können für die Leistungsmessung des Modells nicht angewendet werden, denn im Endresultat werden unrealistisch gute Ergebnisse geliefert. Daher ist es notwendig, eine separate Datensammlung, d.h. Validierungsdaten zu nutzen, um das Modell richtig einzuschätzen. Unser Tool für das tiefe Lernen bildet beide Datensammlungen auf Basis der Bilder, welch durch den Nutzer benennt werden.

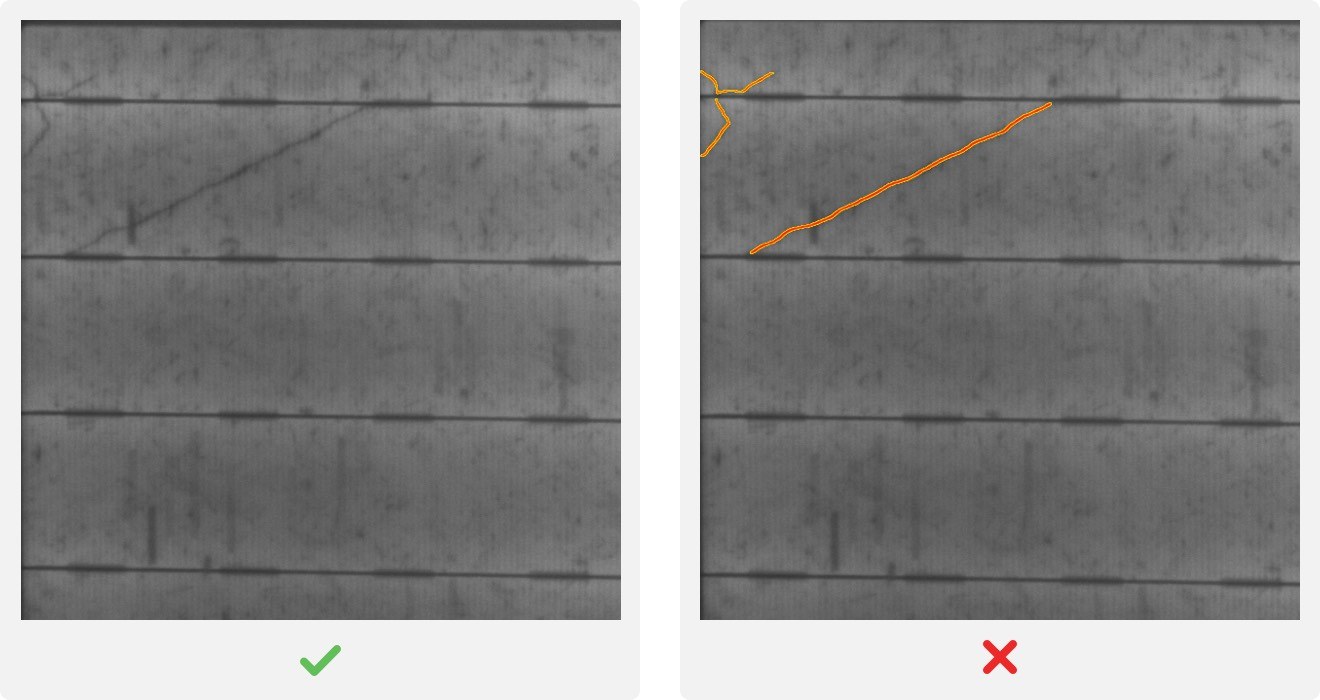

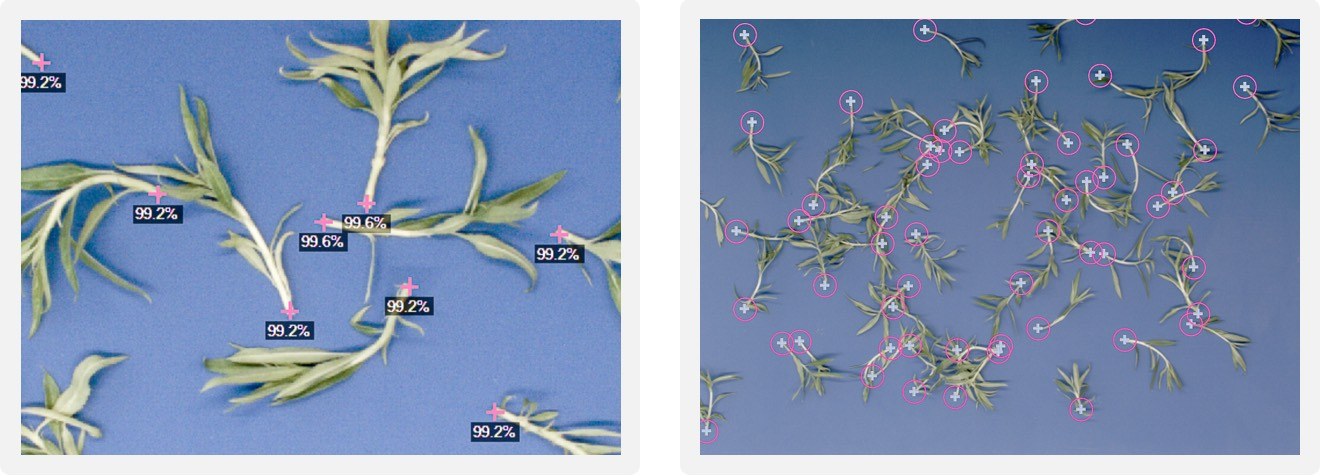

Merkmalserkennung

Beim Vorgang mit Überwachung hat der Nutzer Pixel zu markieren, welche die Defekte auf den Trainingsbildern darstellen. Unser Tool lernt, richtige und richtige Merkmale durch die Beobachtung ihrer grundlegenden Eigenschaften zu unterscheiden.

Inspektion von Photovoltaikmodulen

Bei dieser Anwendung müssen Risse und Kratzer auf einer Oberfläche mit komplexen Merkmalen erkannt werden. Bei herkömmlichen Methoden erfordert dies komplizierte Algorithmen mit Dutzenden von Parametern, die für jeden Paneltyp geändert werden müssen. Mit dem Deep Learning Add-on reicht es aus, das System im überwachten Modus mit einem einzigen Tool zu trainieren.

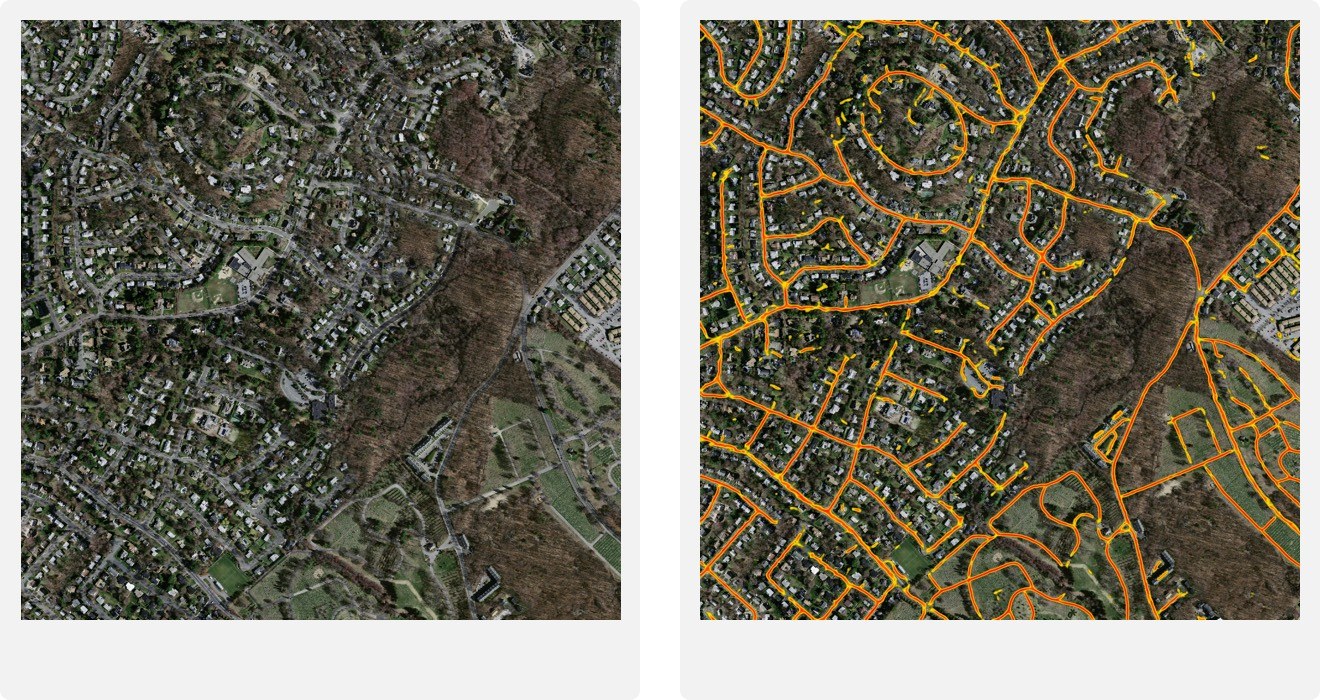

Segmentierung der Satellitenbilder

In Hinsicht auf das Vorkommen mehrerer unterschiedlicher Elemente lassen sich die Satellitenbilder schwierig analysieren. Unser Deep Learning Modul kann austrainiert werden, um Straßen und Gebäude mit höchster Präzision zu erkennen. Das Training kann mittels eines richtig markierten Bildes durchgeführt werden, und die Ergebnisse sind sofort überprüfbar. Legen Sie mehr markierte Proben bei, um die Richtigkeit des Modells zu steigern.

Erkennung von Anomalien

Im Vorgang ohne Überwachung ist der Trainingsprozess einfacher. Eine konkrete Definition des Defekts besteht hier nicht: das Tool wird mittels der richtigen Proben trainiert. Auf ihrer Basis werden sämtliche Abweichungen auf geprüften Bildern gezeigt.

Überprüfung von Verpackungen

Wenn eine Sushi-Packung dem Verkäufer geliefert wird, müssen sich alle Elemente in einer bestimmten Lage befinden. Es ist schwierig, Defekte zu definieren, wenn die Form der richtigen Stücke auch variieren kann. Das Problem lässt sich lösen, indem man das tiefe Lernen ohne Überwachung anwendet, wodurch alle bedeutenden Abweichungen davon erkannt werden, was das Tool im Training gelernt hat.

Kunststoffe, Spritzgussformen

Das Ausformen im Spritzgussverfahren ist ein komplizierter Prozess, in dessen Ablauf mehrere Probleme entstehen können. Gegenstände, die aus Kunststoff hergestellt werden, können für das Biegen bzw. andere Deformationen anfällig sein, welche für den Kunden akzeptabel sind. Unser Deep Learning Modul kann auf Basis der gelieferten Proben alle akzeptablen Verformungen lernen, und anschließend allerlei Abweichungen an der Produktionsanlage erkennen.

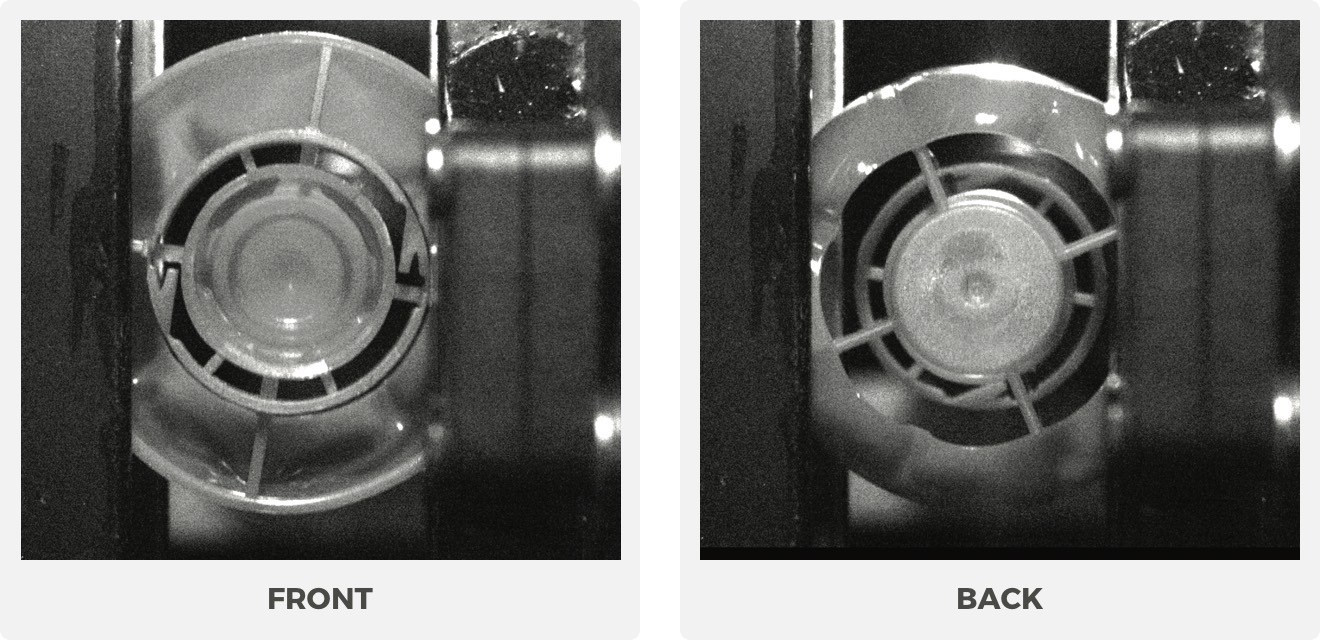

Objektklassifizierung

Das Objektklassifizierungswerkzeug unterteilt Eingabebilder in Gruppen, die vom Benutzer entsprechend ihrer besonderen Merkmale erstellt wurden. Als Ergebnis werden der Name einer Klasse und das Klassifizierungsvertrauen angegeben.

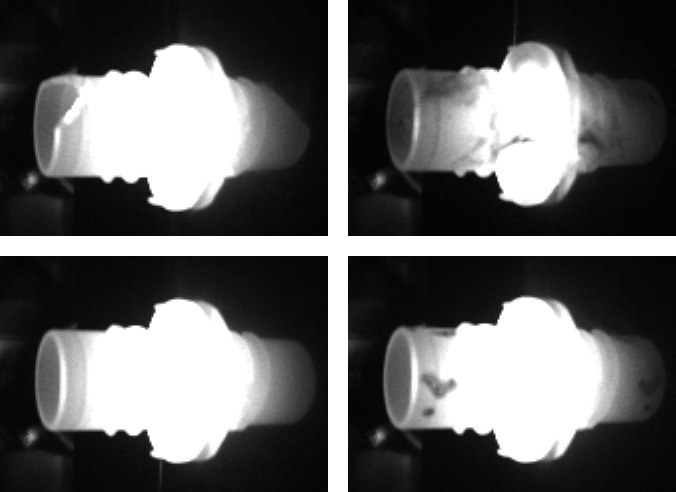

Kunststoffkappen: vorne oder hinten

Kunststoffkappen können manchmal versehentlich in der Produktionsmaschine umdrehen. Der Kunde möchte diese Situation erkennen. Die Aufgabe kann mit herkömmlichen Methoden erledigt werden, erfordert jedoch einen Experten, um einen bestimmten Algorithmus für diese Anwendung zu entwerfen. Auf der anderen Seite können wir eine Deep-Learning-basierte Klassifizierung verwenden, die automatisch lernt, Vorder- und Rückseite anhand einer Reihe von Trainingsbildern zu erkennen.

3D Leichtmetallrad Identifikation

In einem Werk können Hunderte verschiedener Leichtmetallradtypen hergestellt werden. Die Identifizierung eines bestimmten Modells mit solchen Modellmengen ist mit herkömmlichen Methoden praktisch unmöglich. Das Anpassen von Vorlagen würde sehr viel Zeit in Anspruch nehmen, um Hunderte von Modellen abzugleichen, während die Herstellung maßgeschneiderter Modelle einfach zu viel Entwicklung und Wartung erfordern würde. Deep Learning ist eine ideale Lösung, die direkt aus Beispielbildern ohne maßgeschneiderte Entwicklung lernt.

Instanzsegmentierung

Die Instanzsegmentierungstechnik wird verwendet, um einzelne oder mehrere Objekte innerhalb eines Bildes zu lokalisieren, zu segmentieren und zu klassifizieren. Im Gegensatz zur Merkmalerkennungstechnik erkennt diese Technik einzelne Objekte und kann sie möglicherweise trennen, selbst wenn sie sich berühren oder überlappen.

Nuss Segmentierung

Gemischte Nüsse sind ein sehr beliebtes Snack-Food, das aus verschiedenen Arten von Nüssen besteht. Da die prozentuale Zusammensetzung der Nüsse in einer Packung der Liste der auf der Packung aufgedruckten Zutaten entsprechen muss, möchten die Kunden sicherstellen, dass die richtige Menge an Nüssen jeder Art verpackt wird. Das Instanzsegmentierungswerkzeug ist eine ideale Lösung in einer solchen Anwendung, da es Masken zurückgibt, die den segmentierten Objekten entsprechen.

Überprüfung von Verpackungen

Ein typischer Satz Suppengrün, der in Europa verwendet wird, wird in zufälliger Position auf einem weißen Plastikteller verpackt. Produktionslinienarbeiter vergessen manchmal versehentlich, eines der Gemüse auf den Teller zu legen. Obwohl es ein System gibt, das die Platten wiegt, möchte der Kunde die Vollständigkeit des Produkts unmittelbar vor dem Versiegelungsprozess überprüfen. Da es keine zwei Gemüse gibt, die gleich aussehen, besteht die Lösung darin, eine auf tiefem Lernen basierende Segmentierung zu verwenden. In der Schulungsphase muss der Kunde lediglich Regionen markieren, die Gemüse entsprechen.

Punktorung

Das Werkzeug Punktposition sucht nach bestimmten Formen, Merkmalen oder Markierungen, die als Punkte in einem Eingabebild identifiziert werden können. Es kann mit dem herkömmlichen Template-Matching verglichen werden, aber hier wird das Tool mit mehreren Samples trainiert und wird robust gegen große Variabilität der interessierenden Objekte.

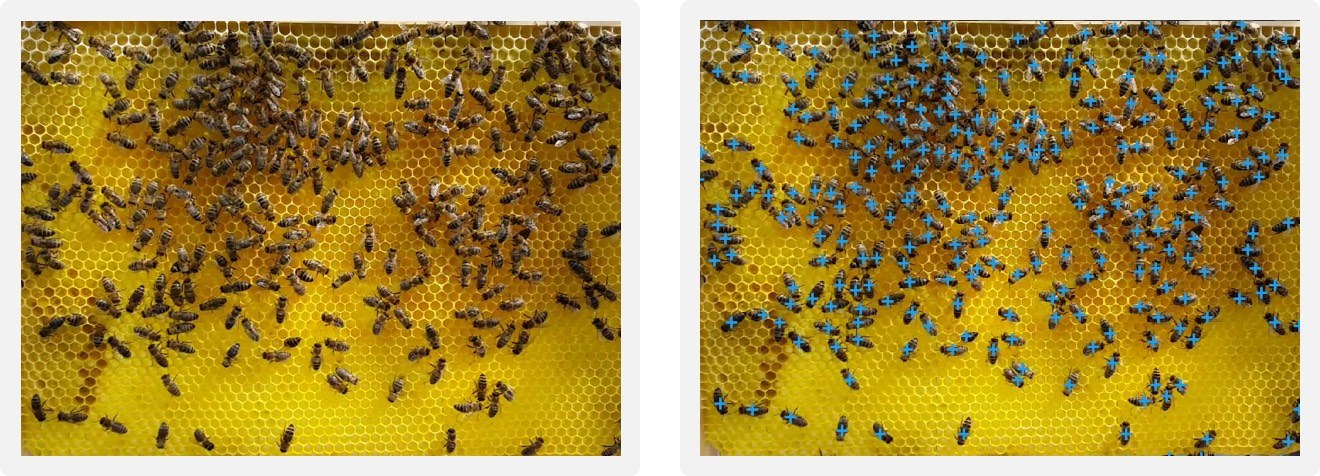

Bienen verfolgen

Die Aufgabe, die mit herkömmlichen Bildverarbeitungsmethoden unmöglich zu erfüllen scheint, kann mit unserem neuesten Tool erledigt werden. In diesem Fall verwenden wir es, um Bienen zu erkennen. Wenn dies erledigt ist, können wir überprüfen, ob sie durch Varroose infiziert sind - die Krankheit, die durch die parasitären Milben verursacht wird, die die Honigbienen angreifen. Der Parasit bindet sich an ihren Körper und aufgrund einer charakteristischen roten Entzündung können wir ihn nach seinem Gesundheitszustand klassifizieren. Dieses Beispiel zeigt nicht nur, dass es eine einfache Lösung für eine komplexe Aufgabe ist, sondern dass wir auch für viele verschiedene Industriezweige offen sind, z. Landwirtschaft.

Pick-and-Place

In diesen Anwendungen müssen wir einen Roboterarm führen, um Gegenstände aufzunehmen, typischerweise von einem Förderband oder von einem Behälter. Ein gutes Beispiel für eine solche Anwendung ist das Pflücken kleiner Stecklinge und das vertikale Einsetzen in Töpfe. Ungenauigkeiten bei der Erkennung können dazu führen, dass sie zu tief oder verkehrt herum gepflanzt werden, was dazu führt, dass Stecklinge keine Wurzeln bilden. Unsere Deep-Learning-Tools ermöglichen es, die gewünschten Pflanzenteile schnell zu lokalisieren und genaue Ergebnisse zu liefern, die für diesen Vorgang erforderlich sind.